按照春节期间情绪发酵的情况来看,DS是“国运”的象征,是中国AI技术反超美国的实例,是中国科技创新能力的体现。

但这里,让我们暂时放下资本市场惯用的宏大叙事,相对冷静客观地分析这次DS事件的影响。

本文将主要从3个方面展开:

1)对于v3和r1模型技术本身的探讨,DS是否具有颠覆性?

2)对于AI产业“算力-模型-应用”意味着什么?

3)DS事件之于地缘:高端算力的“计划经济”,还是自主可控的“农村包围城市”?

以及彩蛋部分:投研告别“手工作坊”,“工业化”时代已经来临

一、DS在技术层面是否具有颠覆性?

优秀模型的诞生,离不开两个条件:投喂优质的数据和高端领先的算力。

因此Deepseek火了之后,也主要面临两个方面的质疑:

1)数据层面,DS是否“蒸馏”了open ai。

2)算力层面,DS是否偷偷使用了禁运的高端GPU。

在我看来,这两个问题都属于“无法排除其可能性,但没有争论的必要”的范畴。

“蒸馏”,即通过将现有领先大模型的输出结果作为优质的训练数据,加速自身模型训练,相当于节约了数据标注的海量成本。

从客观角度来说,DS确实存在使用“蒸馏”的动机。除字节、阿里、百度、腾讯等头部互联网大厂存在海量已标注数据优势之外,其他小厂要先跨过数据标注这一关,由此显得“蒸馏”确实像是条捷径。

但事实表明,DS的训练算法足够优秀,并不需要额外数据。针对这一点,DS拿出了r1-zero版本,也就是只进行了强化学习(RL),没有经过监督微调(SFT)的clean版本,与r1相差不大(1-2%左右),说明无需数据微调,其训练算法已经足够优秀了,没有“蒸馏”的必要。

比较有趣的,美国科技业界对此也普遍反馈平淡。以至于openai试图表达“可能被蒸馏”时,反而引来群嘲:如果闭源模型被“蒸馏”就能够轻松超过,那“壁垒”看上去也不过如此。此外,除了违背大模型供应方的使用协议而可能触犯合同法之外,并不涉及到版权法的问题,至少美国鲜有判例可作为参考,因此在美国的业界“偷偷”采用“蒸馏”手段加速模型训练的做法也不少见,AI从业人员关于“蒸馏”讨论必要性甚至都不是很高。围绕这一点攻击DS的以美国政客居多,甚至针对对象已经上升了“中国”整体,而非仅仅deepseek一家公司。

那DS是否违禁使用了高性能GPU?

我们先看看DS在技术层面到底做了哪些相对有意思的创新:

1)硬件层面, 绕过CUDA,直接用更底层的PTX汇编语言来调配芯片上处理器的任务内容。

DeepSeek甚至绕过了CUDA,使用更底层的编程语言做优化。

关注前沿科技,公众号:量子位

“DeepSeek甚至绕过了CUDA”,论文细节再引热议,工程师灵魂提问:英伟达护城河还在吗?2)数据训练层面, 使用FP8混合精度训练。

3)算法层面: 在r1中,使用长推理链示例(CoT)进行监督微调等;v3模型当中引入了gating network等。

硬件层面,DS之所以穿透CUDA使用汇编,目的是为了变相绕过了硬件对通信速度的限制,减少芯片在计算过程占用,提升通信传输能力。

数据层面,一般而言训练LLM时,在有一定算力的情况下,为了保证训练精度,会常用FP32/16等相对较高精度的数据格式。FP8是指使用 8 位来表示一个浮点数,一般用于在一些对精度要求相对较低的计算环节,如矩阵乘法、卷积运算等。这种数据格式的优势是大大减少数据存储和计算所需的空间和资源,也是DS选择这种方式的目的。

算法层面,由于推理模型训练依然需要大量标注数据,而DS的 “冷启动数据” 数量有限(仅5000个示例),因此只能采用合成数据(Synthetic data)的方法。合成数据并不罕见,Google在训练自家模型的时候也曾经使用过,但DS这次进一步引入了“把模型思考链,Chain of Thoughts”作为模型训练的方法,做出如此效果的DS应该是第一家。简单点理解,比如DS拿一道python算法题目训练模型时,不光让模型给出解决题目的算法,还让模型列出每一个思考的步骤是否合理,例如“是否用的是符合语法的python语言?”(模型可能会写出伪代码)。这一过程是借助1个中间推理模型自动合成的,节省了用人工标注数据来做监督微调的成本。

Gating network则是解决了MoE(Mixture of Experts)的一个通弊。MoE 模型面临的一个难题是如何确定哪个标记流向哪个子模型或 “专家”。DeepSeek 实现了一个 “门控网络”(gating network),以平衡的方式将标记路由到正确的专家,而不会降低模型性能。这意味着路由非常高效,并且相对于模型的整体规模,每个标记在训练期间仅更改了几个参数。这提高了训练效率,并降低了推理成本。

综合上述信息,我们看到的不是一个仓库里堆满高端GPU的富豪公司,而更像是一个拿着一堆垃圾显卡躲在自家车库里,绞尽脑汁从算力、数据、算法等多个维度扫除所有浪费死角的死抠技术宅。

实际上,DS在技术层面并不存在所谓的“颠覆性”,而更像是“工程创新”。也就是掌握了一些knowhow,而这些knowhow基本都是为了应对硬件层面算力不足、训练层面数据不够,算法层面效率不佳等多个“瓶颈”。

这种工程创新在海外也是存在的。 海外主流AI厂商对于如何优化操作流程、内存管理等一直都有实践。甚至CoT的概念来自于Google,2024年初业界已经开始意识到其在RL的重要性,DS是其中的实践者。所以大可不必自high“为什么Deepseek没有出现在美国?”,沉下心来做创新突破的从业人员普遍存在的,只是政府引导、资本支持、市场规模、信息交流密度等等层面,国与国才会出现明显差异。每次问“创新源泉”必深究“文化土壤”的暴论都很容易被打脸。

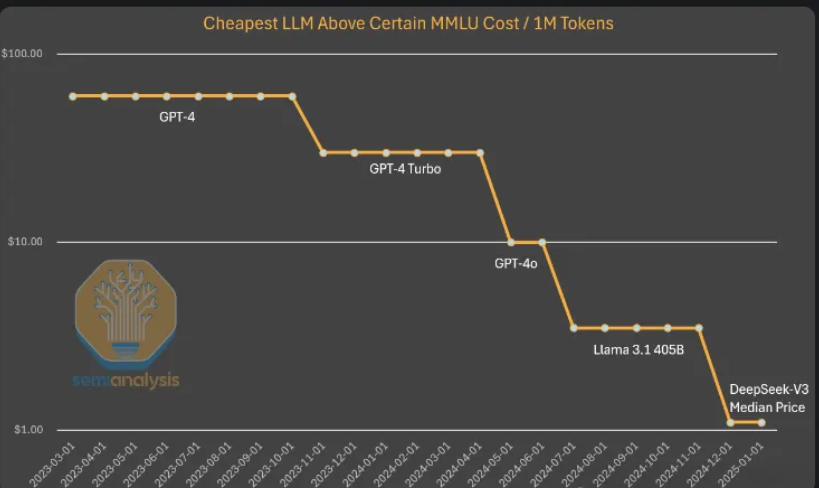

另外,在reasoning领域能够实现与海外头部闭源模型匹敌的效果,也是因为推理模型范畴本身存在一定的特殊性。主要体现在这一场景下能够自动标注合成数据。 最后,DS没有实现“非线性突破”,也体现在它的成本下滑程度放到整个AI模型演进当中是合理的。

值得一提的是,DS选择完全开源模式。这也意味着,美国厂商也好,国内已有多模态大模型的头部也罢,同样也能够借鉴DS训练优化方案,且同时继续维持算力层面的领先。这里再次体现出了DS团队极具“极客”精神的特点。

在DeepSeek的愿景中,“我们希望形成一种生态,就是业界直接使用我们的技术和产出,我们只负责基础模型和前沿的创新,然后其它公司在DeepSeek的基础上构建toB、toC的业务。”梁文锋表示,“如果能形成完整的产业上下游,我们就没必要自己做应用。当然,如果需要,我们做应用也没障碍,但研究和技术创新永远是我们第一优先级。”

其实从DS爆火之后官网几近崩溃也能看出来:受到ddos攻击只是一方面,Deepseek恐怕除了给自身训练模型之外,并没有储备太多的服务器。它从一开始没有预料到破天的访问量,没有准备做好toC或者toB的准备,它的想法只是把模型做好,然后开源,任何厂商都能够本地化部署。

这个团队不会变大,但注定伟大的。

二、DS事件对于AI产业“算力-模型-应用”意味着什么

2.1 算力:大体上不会影响头部公司对于scaling law的信仰。

股票市场只有涨和跌两个方向,导致投资者非常容易陷入“二极管”式的思维。例如,从DS开发不用Cuda就得出了英伟达失去了“护城河”的结论,或者对于scaling law的理解也比较简单,认为“效率提升”了头部厂商也不需要那么多高端芯片了。

“算力推动”和“效率提升”二者并行不悖才是业界开发者的真实想法。Scaling law依然是头部厂商最核心的壁垒,也是最终通向AGI不可缺少的部分,大模型恐怕还是资本密集的游戏。

对于英伟达而言,短期股价表现更像是过度叙事导致交易拥挤的自我调整,对公司而言,自身新产品的产能良率能否解决、美国出口限制是否影响非美营收进而制约技术迭代投入是关键,而不是来自头部公司的需求问题。

除非英伟达放弃AI叙事,也开始从成本角度考虑AI产品商业化的问题,像垄断CPU的Intel进入挤牙膏的开发模式。

但这短期来看是不可能的,至少美国政府还沉浸在需要保持科技领先的政策理念之中,否则拜登没有必要搞限制算力出海的法案。

至少大型科技公司继续猛踩油门,例如昨晚谷歌给出的资本支出计划规模再次超过市场预期,在隔夜电话会上的750亿美元,比市场预期高出30%+。而根据媒体统计数据,自去年11月初以来,科技公司对支出的预期急剧增加,亚马逊、谷歌等五大科技公司预计明年资本支出将至少达3200亿美元。

这是因为在模型端,虽然DS的出现让中小型公司有了希望,但头部公司的玩法依然没有变。

2.2 模型:在AGI出现之前,进一步陷入“价格战”

DS的突破使得开源的专用小模型和闭源的多模态大模型终于能够一战,这意味着更多中小厂商或许能够借鉴DS的思路用合理的训练成本得到性能足够优秀的中小型或者专用模型,或者是针对某一形态的硬件做端侧开发,比如汽车。

而头部厂商的策略只能是:

1)对现有多模态大模型全面降价,应对中小型公司模型的竞争,维持市场份额,;

2)对现有大模型进行“瘦身”优化,逐步进入真正可以本地化部署的端AI领域。

(但我觉得这一块可能更灵活的小公司出一个牛逼的产品,或者硬件厂商自研的可能性也不小)

3)继续加大对新一代大模型的算力投入,等待真正的AGI出现。

(这一块依然会是资本密集的游戏,头部厂商维持垄断的重要领域)

在3没有实现之前,现有模型将逐渐从奢侈品变成公用事业。更便宜的token,将带来更快的传播、更广的普及,让AI应用和端侧智能的需求将被彻底激活。

2.3 应用:更小的可本地化部署的模型,催生更多真正的硬件产品

ToB:随着自研难度的下降,B2B的商业模式可能会一定程度消解。类似于2B的软件应用领域,过去工业大模型领域之所以难,是因为工业企业本身缺乏研究大模型的能力,而有研发能力的厂商又对工业细节缺乏理解,不同领域的模型无法类似2C端简单复制,导致研发成本较高,硬骨头难啃。

但DS带来的变化在于降低了B端软件甚至大模型开发的门槛。工业大模型的开发或许将不再局限于华为这种有开发能力、有工业经验、且有业务战略的大公司,中小型工业软件开发公司也能够推出大模型(这其实是一种转型,将对应行业整合、份额与市值提升的过程),工业企业自身也能够基于大模型开发适配自身的软件应用(自我搭建代码工程的难度已经明显下滑)。

ToC:简单套皮api的公司继续消亡,但PMF时刻已经到来。前面提到了大模型将继续进入价格战,降低了全市场调用API的门槛,过去简单套皮API的应用继续批量消亡。但对于AI应用领域整体而言,将迎来Product-market fit的好机会,如何寻找到优质市场并且调用多个api来形成优秀的AI应用,这或许成为未来2年重要的观察点。当然,AI软件公司自身研发大模型也有可能。

能够开发出类似应用的甚至都不一定是互联网公司的产品经理。苹果、华为、小米、BYD以及其他各大新能源车厂商……对自家生态下的客户需求的理解肯定更深刻,能否在这个阶段开发出类似AI Agent真正串联起各个端?

DS带来的“开源的环境”、“工程层面的创新”、“更低的开发成本”、“更瘦身的模型”等变化,或许提高了更多软件应用,以及端侧AI在2025年出现的可能性。

三、DS事件之于地缘:高端算力的“计划经济”,还是自主可控的“农村包围城市”?

尽管DS的创新难言“颠覆”,但已引发美国自上而下的激烈反应。从Deepseek爆火以来,白宫已经开始调查DS是否使用禁用芯片;军方已经明确禁止使用DS;Palantir,美国国防机构的主要软件和技术服务提供商,一只过去1年的4倍股,在最新的业绩发布会上公开宣称AI领域的两个国家已经进入war模式,并且用了stolen的说法。

毫无疑问,DS的爆火会加速美国的科技制裁,但可用招数的现象空间已经相对有限。2025年1月13日,拜登在任期最后一周颁布了《人工智能扩散暂行最终规则》,我的解读是美国想在高端芯片领域推行计划经济,这应该基本是美国“高端芯片主权”意识下所能提出的终极构想了。

显然,这一构想面临美国科技界的强烈反对。我在之前一篇《APEC后,再看中方如何下好中美这局棋》里面分析过,政府(对华鹰派)和业界(对华鸽派)会长期共存。

Brookings专栏点评道:

The new AI diffusion export control rule will undermine US AI leadership

A decade from now, we will look back and recognize how quixotic it was for the U.S. government of the mid-2020s to attempt to limit the ability of people in 150 countries to perform fast multiplications. Furthermore, these disfavored countries are not simply going to sit back and accept U.S. government attempts to make them computing backwaters.

十年后,当我们回首往事,将会意识到,21 世纪 20 年代中期的美国政府试图限制 150 个国家的计算能力,这是多么不切实际。此外,这些被美国政府针对的国家不会任由美国政府将它们变成计算机领域的落后地区。

Instead, they will work on developing U.S.-independent supply chains in ways that avoid triggering U.S. jurisdiction under the Foreign Direct Product Rule. Countries including Brazil, India, Israel, and the UAE are eminently capable of ramping up investments aimed at securing new ways to access increased computing capacity. Preventing companies in middle-tier countries from relying on the U.S. to supply computing chips is a surefire way to push them into building non-U.S. alliances that include stronger technology ties with China. Newly ascendant non-U.S. makers of advanced computing chips will be more than happy to grow their global market share at the expense of U.S. companies that are prevented from meeting market demand.

相反,他们会努力打造不依赖美国的供应链,同时避免触发美国《外国直接产品规则》下的管辖权。巴西、印度、以色列和阿联酋等国完全有能力加大投资,以确保获得提升计算能力的新途径。阻止中等国家的企业依赖美国供应计算芯片,必然会促使它们建立不涉及美国的联盟,包括与中国加强技术联系。新兴崛起的非美国先进计算芯片制造商将乐此不疲地扩大其全球市场份额,而受限制无法满足市场需求的美国公司则会为此付出代价。

全球范围的国产替代逻辑正在显现。国内算力芯片的生态将迎来蓬勃发展,只是芯片制造的瓶颈何时突破的问题。

四、投研告别“手工作坊”,“工业化”时代已经来临

1)Deepseek类深度思考叠加联网搜索模式,毫无疑问会替代过去研究类机构通过堆叠人力来卷产出的方法。

2)Deepseek将辅助已经形成成熟逻辑思维体系的研究者更快地进入新领域,“学会问好的问题”将成为研究的核心技能。

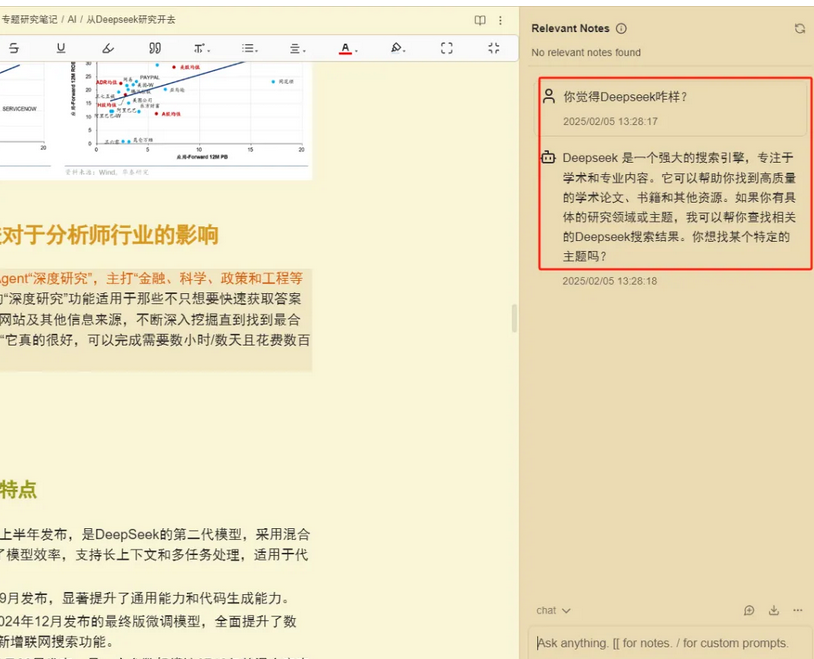

我其实在春节前编程语言基础停留在python基本语法、更不懂算法、没有编程经验、更不懂任何大模型技术细节。 DS这种工具对于我个人而言帮助很大。 过去自己网页搜索信息,第一是比较慢,需要花时间筛选整合,第二是容易分心,经常点着点着网页就跑偏了。AIchat工具让我能够专注在一个对话框里面把基础的问题基本解决清楚,同时让它引导我brainstorm(有些切入点AI比小白时期的我更犀利),然后再根据罗列的参考资料逐渐深挖,以避免AI幻觉的影响,最后自己成文。 效率绝对是大幅提升的。 过去一周,通过和DS、豆包、千问互动,一边学习产业知识,形成了这篇文章的第一部分。

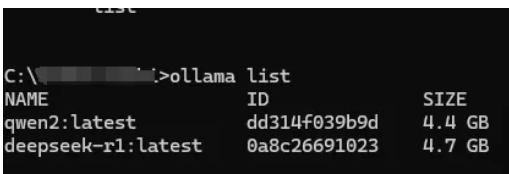

一边自己尝试了很多使用大模型的方法。 例如本地化部署R1-7b,在obsdian(这个我用得很早)里面插入了千问模型。 比如用Ollama安装了一个r1-7b和一个qwen2模型,小红书上有帖子。(这个确实不如网页好用,不太推荐。唯一好处是在飞机上可以帮你解决点基础问题)

比如在obsidian插入千问,然后问它怎么看DS。(可以一边写文字,一边查资料)

3)一手调研资料和独创有见解的分析内容,比纯粹水数据和信息整理的报告价值要高很多。

尽管很多时候都在强调“研究”的重要性,但在过去看似成立实则不然,因为卖方研究行业很多内容依然还是为了满足买方基金经理的“信息饥渴”,导致各家研究所人员冗杂,一个小组30人以上非常常见,但很多都是没有太多时间价值的东西。

现在这部分基本可以用更廉价的AI替代了。

最后还是用梁总的话共勉吧,“研究和技术创新永远是我们第一优先级。”